AI đang di chuyển từ máy tính và điện thoại sang robot và xe tự lái và hầu như bất kỳ không gian kỹ thuật số nào có thể tưởng tượng được. Ngay cả CEO của NVIDIA Jensen Huang cũng đã nêu ra điều này tại hội nghị GTC của công ty vào tháng 3.

Accenture cho biết AI tạo sinh đang phát triển nhanh chóng, với 75% nhân viên tri thức sử dụng công nghệ này để tạo nội dung như tài liệu bán hàng hoặc tự động hóa mã hóa .

Chìa khóa cho kết quả AI hiệu quả là một chiến lược AI tập trung có tính đến nhiều yếu tố kỹ thuật và vận hành khác nhau. Các trường hợp sử dụng khác nhau sẽ yêu cầu các mô hình và quy trình khác nhau, cũng như quyền truy cập vào dữ liệu chất lượng cao để giúp tối đa hóa năng suất.

Tăng năng suất không phải là cân nhắc duy nhất. Khi các tổ chức đưa các dự án AI của mình vào hoạt động, họ cũng phải tôn trọng ngân sách và bảo vệ dữ liệu của mình. Và giống như tất cả các công nghệ mới nổi, AI cũng đặt ra những rào cản trong quá trình triển khai.

Tùy chọn triển khai AI

Đứng đầu trong số này là các mô hình ngôn ngữ lớn (LLM), đòi hỏi các kỹ thuật đào tạo, suy luận, tinh chỉnh và tối ưu hóa để làm nền tảng cho GenAI. Một số tổ chức gặp khó khăn với các khoảng cách kỹ năng AI, khiến việc sử dụng hiệu quả các công nghệ như vậy trở nên khó khăn.

Để giảm bớt gánh nặng này, một số tổ chức chọn sử dụng LLM do các nhà cung cấp dịch vụ đám mây công cộng quản lý hoặc chạy LLM theo lựa chọn của họ trên các nền tảng của bên thứ ba đó.

Mặc dù đám mây công cộng hấp dẫn vì rút ngắn thời gian ra mắt nhưng nó cũng có những đánh đổi. Chi phí thay đổi, độ trễ cao hơn và các mối lo ngại về bảo mật dữ liệu và chủ quyền có thể khiến việc chạy khối lượng công việc AI ở đó trở nên không hấp dẫn hoặc thậm chí không khả thi.

Khối lượng công việc AI cũng đưa ra nhiều biến số hơn để những người ra quyết định CNTT cân nhắc. Mặc dù hấp dẫn như nhiều lựa chọn hơn, nhưng nó cũng có thể làm phức tạp thêm.

Theo đó, việc chạy cơ sở hạ tầng, bao gồm tính toán, lưu trữ và GPU, tại chỗ giúp các tổ chức có khả năng kiểm soát mọi khía cạnh của việc triển khai. Ví dụ, cơ sở hạ tầng tại chỗ mang lại giá trị lớn cho việc triển khai khối lượng công việc AI lớn, có thể dự đoán được, gần hơn với nơi dữ liệu được xử lý, cho phép các tổ chức tôn trọng ngân sách của mình.

Đảm bảo kiểm soát chặt chẽ của tổ chức cũng là yếu tố tiên quyết để bảo vệ các mô hình AI, dữ liệu đầu vào và đầu ra, có thể bao gồm IP nhạy cảm, khỏi những tác nhân xấu và rò rỉ dữ liệu.

Một số tổ chức phải ưu tiên bảo mật dữ liệu và các yêu cầu về chủ quyền dữ liệu yêu cầu dữ liệu phải nằm trong các địa điểm địa lý cụ thể để tuân thủ các quy định của địa phương. Bằng cách chạy khối lượng công việc AI tại nơi có dữ liệu, các tổ chức có thể duy trì tính tuân thủ đồng thời tránh việc chuyển dữ liệu trùng lặp giữa các hệ thống và địa điểm.

Để đạt được mục đích đó, nhiều tổ chức hiện nay đang tùy chỉnh LLM nguồn mở bằng cách sử dụng thế hệ tăng cường truy xuất (RAG). Các tổ chức có thể sử dụng RAG để tùy chỉnh chatbot nhằm cung cấp phản hồi nhanh chóng cho các trường hợp sử dụng cụ thể.

Hơn nữa, khi các LLM tiếp tục thu hẹp quy mô trong khi vẫn duy trì hiệu suất và độ tin cậy cao, ngày càng có nhiều mô hình chạy trên máy tính xách tay như PC AI hoặc máy trạm tại cơ sở và ở biên.

Theo Enterprise Strategy Group , các yếu tố này nhấn mạnh lý do tại sao 73% tổ chức thích tự triển khai LLM dựa trên cơ sở hạ tầng hoạt động tại các trung tâm dữ liệu, thiết bị và vị trí biên.

AI tại chỗ có thể tiết kiệm chi phí hơn

Dữ liệu thực nghiệm so sánh giá trị của việc triển khai tại chỗ với đám mây công cộng rất khan hiếm, nhưng gần đây đã được ESG nghiên cứu.

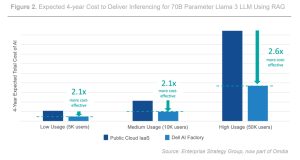

Công ty nghiên cứu đã so sánh chi phí dự kiến để cung cấp khả năng suy luận cho một chatbot dựa trên văn bản được hỗ trợ bởi LLM mã nguồn mở có 70B tham số chạy RAG tại chỗ với giải pháp đám mây công cộng tương đương từ Amazon Web Services.

Phân tích ước tính chi phí hỗ trợ cơ sở hạ tầng và quản trị hệ thống cho khoảng 5.000 đến 50.000 người dùng trong khoảng thời gian bốn năm, phát hiện ra rằng chạy khối lượng công việc tại chỗ có hiệu quả về mặt chi phí hơn tới 62% so với đám mây công cộng trong việc hỗ trợ suy luận.

Hơn nữa, cùng một triển khai tại chỗ có hiệu quả về mặt chi phí hơn tới 75% khi so sánh với chi phí chạy dịch vụ dựa trên API từ OpenAI. Tất nhiên, mức tiết kiệm của mỗi tổ chức sẽ khác nhau tùy theo trường hợp sử dụng và kịch bản mô hình hóa.

Giải pháp tại chỗ được nêu trong nghiên cứu ESG bao gồm Dell AI Factory, một phương pháp hiện đại được thiết kế để giúp các tổ chức mở rộng quy mô giải pháp AI và xây dựng kết quả kinh doanh tốt hơn.

Dell AI Factory kết hợp cơ sở hạ tầng và dịch vụ chuyên nghiệp của Dell, kết nối với hệ sinh thái mở của các nhà cung cấp phần mềm và các đối tác khác có thể hỗ trợ các trường hợp sử dụng AI của bạn hiện tại và trong tương lai.

Việc xây dựng một chiến lược tập trung cho kỷ nguyên AI mới này ở khắp mọi nơi là điều tuyệt vời, nhưng công việc không dừng lại ở đó. Dell AI Factory có thể giúp bạn định hướng trên hành trình AI của mình.

Bài viết mới cập nhật

Dell Storage Engines: Tăng tốc suy luận AI với PowerScale và ObjectScale

Giải pháp chuyển tải bộ nhớ đệm KV của Dell cho ...

Bảo vệ Nhà máy AI

Áp dụng phương pháp tiếp cận kiến trúc để bảo mật ...

Tiến lên mạnh mẽ với Dell PowerMax: Vượt mặt Hitachi VSP 5000

Dell PowerMax mang lại khả năng phục hồi, hiệu suất và ...

Đẩy nhanh đổi mới AI: Sức mạnh của quyền truy cập mở

Từ các mô hình tiên tiến đến các ứng dụng cấp ...