Máy chủ Dell EMC PowerEdge R7525 cung cấp Kết quả MLPerf Inference v0.7 đặc biệt , cho biết rằng:

- Dell Technologies giữ vị trí số 1 về hiệu suất trên mỗi GPU với GPU NVIDIA A100-PCIe trên kịch bản Máy chủ DLRM-99

- Dell Technologies giữ vị trí số 1 về hiệu suất trên mỗi GPU với NVIDIA A100-PCIe trên kịch bản Máy chủ DLRM-99.9

- Dell Technologies giữ vị trí số 1 về hiệu suất trên mỗi GPU với NVIDIA A100-PCIe trên kịch bản Máy chủ ResNet-50

Bản tóm tắt

Trong blog này, chúng tôi cung cấp các con số hiệu suất của máy chủ Dell EMC PowerEdge R7525 được phát hành gần đây của chúng tôi với hai GPU NVIDIA A100 trên tất cả các kết quả của điểm chuẩn MLPerf Inference v0.7. Kết quả của chúng tôi chỉ ra rằng máy chủ PowerEdge R7525 là một lựa chọn tuyệt vời cho khối lượng công việc suy luận. Nó mang lại hiệu suất tối ưu cho các tác vụ khác nhau trong điểm chuẩn MLPerf Inference v0.7. Các tác vụ này bao gồm phân loại hình ảnh, phát hiện đối tượng, phân đoạn hình ảnh y tế, chuyển lời nói thành văn bản, xử lý ngôn ngữ và đề xuất.

Máy chủ PowerEdge R7525 là máy chủ giá đỡ 2U, hai ổ cắm, được thiết kế để chạy khối lượng công việc bằng cách sử dụng cấu hình mạng và I/O linh hoạt. Máy chủ PowerEdge R7525 có bộ xử lý AMD EPYC thế hệ thứ 2, hỗ trợ tới 32 DIMM, có các khe cắm mở rộng hỗ trợ PCI Express (PCIe) Gen 4.0 và cung cấp nhiều lựa chọn công nghệ giao diện mạng để bao gồm các tùy chọn kết nối mạng.

Hình dưới đây cho thấy giao diện phía trước của máy chủ PowerEdge R7525:

Hình 1. Máy chủ Dell EMC PowerEdge R7525

Máy chủ PowerEdge R7525 được thiết kế để xử lý khối lượng công việc đòi hỏi khắt khe và cho các ứng dụng AI chẳng hạn như đào tạo AI cho các loại mô hình khác nhau và suy luận cho các kịch bản triển khai khác nhau . Máy chủ PowerEdge R7525 hỗ trợ nhiều bộ tăng tốc khác nhau như NVIDIA T4, NVIDIA V100S, NVIDIA RTX và NVIDIA A100 GPU s. Các phần sau đây so sánh hiệu suất của GPU NVIDIA A100 với GPU NVIDIA T4 và NVIDIA RTX sử dụng MLPerf Inference v0.7 làm điểm chuẩn.

Bảng sau đây cung cấp thông tin chi tiết về cấu hình máy chủ PowerEdge R7525 và môi trường phần mềm cho MLPerf Inference v0.7:

| Thành phần | Sự mô tả |

| bộ vi xử lý | Bộ xử lý 32 nhân AMD EPYC 7502 |

| Kỉ niệm | 512 GB (32 GB 3200 tấn/giây * 16) |

| đĩa cục bộ | 2 ổ SSD 1,8 TB (Không RAID) |

| Hệ điều hành | Bản phát hành CentOS Linux 8.1 |

| GPU | NVIDIA A100-PCIe-40G, T4-16G và RTX8000 |

| Trình điều khiển CUDA | 450.51.05 |

| Bộ công cụ CUDA | 11,0 |

| Các thư viện liên quan đến CUDA khác | TensorRT 7.2, CUDA 11.0, cuDNN 8.0.2, cuBLAS 11.2.0, libjemalloc2, cub 1.8.0, nhánh mlperf của phòng thí nghiệm tensorrt |

| ngăn xếp phần mềm khác | Docker 19.03.12, Python 3.6.8, GCC 5.5.0, ONNX 1.3.0, TensorFlow 1.13.1, PyTorch 1.1.0, torchvision 0.3.0, PyCUDA 2019.1, SacreBLEU 1.3.3, Simplejson, OpenCV 4.1.1 |

| Hồ sơ hệ thống | Màn biểu diễn |

Để biết thêm thông tin về cách chạy điểm chuẩn, hãy xem Chạy Điểm chuẩn MLPerf Inference v0.7 trên Hệ thống Dell EMC .

Kết quả hiệu suất MLPerf Inference v0.7

Điểm chuẩn suy luận MLPerf đo lường tốc độ mà một hệ thống có thể thực hiện suy luận máy học (ML) bằng cách sử dụng một mô hình được đào tạo trong các tình huống triển khai khác nhau. Các kết quả sau đây đại diện cho các kịch bản Ngoại tuyến và Máy chủ của điểm chuẩn Suy luận MLPerf. Để biết thêm thông tin về các kịch bản, mô hình, tập dữ liệu, mục tiêu chính xác và giới hạn độ trễ khác nhau trong MLPerf Inference v0.7, hãy xem Hiệu suất học sâu với MLPerf Inference v0.7 Benchmark .

Trong khung đánh giá suy luận MLPerf, trình tạo tải LoadGen gửi các truy vấn suy luận đến hệ thống đang được thử nghiệm, trong trường hợp của chúng tôi là máy chủ PowerEdge R7525 với các cấu hình GPU khác nhau. Hệ thống đang thử nghiệm sử dụng một chương trình phụ trợ (ví dụ: TensorRT, TensorFlow hoặc PyTorch) để thực hiện suy luận và gửi kết quả trở lại LoadGen.

MLPerf đã xác định bốn kịch bản khác nhau cho phép thử nghiệm đại diện cho nhiều nền tảng suy luận và trường hợp sử dụng khác nhau . Trong blog này, chúng tôi thảo luận về hiệu suất kịch bản Ngoại tuyến và Máy chủ. Sự khác biệt chính giữa các kịch bản này dựa trên cách gửi và nhận truy vấn:

- Ngoại tuyến —Một truy vấn với tất cả các mẫu được gửi đến hệ thống đang thử nghiệm. Hệ thống được kiểm tra có thể gửi lại kết quả một lần hoặc nhiều lần theo bất kỳ thứ tự nào. Số liệu hiệu suất là mẫu mỗi giây.

- Máy chủ —Các truy vấn được gửi đến hệ thống đang thử nghiệm theo phân phối Poisson (để lập mô hình các sự kiện ngẫu nhiên trong thế giới thực). Một truy vấn có một mẫu. Chỉ số hiệu suất là số truy vấn mỗi giây (QPS) trong giới hạn độ trễ.

Lưu ý : Cả số liệu hiệu suất cho kịch bản Ngoại tuyến và Máy chủ đều thể hiện thông lượng của hệ thống.

Trong tất cả các điểm chuẩn, hai GPU NVIDIA A100 vượt trội hơn tám GPU NVIDIA T4 và ba GPU NVIDIA RTX800 cho các kiểu máy sau:

- Mô hình phân loại hình ảnh ResNet-50

- Mô hình phát hiện đối tượng SSD-ResNet34

- Mô hình nhận dạng giọng nói RNN-T

- Mô hình xử lý ngôn ngữ BERT

- Mô hình khuyến nghị DLRM

- Mô hình phân đoạn hình ảnh y tế 3D U-Net

Các biểu đồ sau đây cho thấy hiệu suất của máy chủ PowerEdge R7525 với hai GPU NVIDIA A100, tám GPU NVIDIA T4 và ba GPU NVIDIA RTX8000 với điểm chuẩn mục tiêu chính xác 99% và mục tiêu chính xác 99,9% cho điểm chuẩn áp dụng:

- Điểm chuẩn mục tiêu chính xác 99% (độ chính xác mặc định): ResNet-50, SSD-Resnet34 và RNN-T

- Điểm chuẩn mục tiêu chính xác 99% và 99,9% (độ chính xác cao): DLRM, BERT và 3D-Unet

Điểm chuẩn mục tiêu chính xác 99%

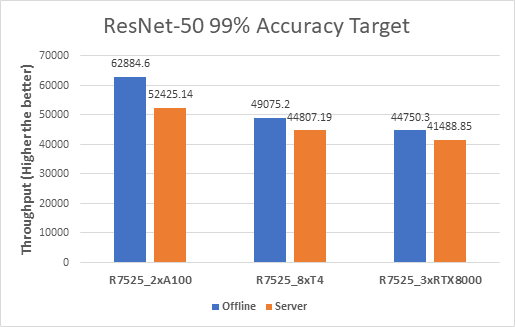

ResNet-50

Hình dưới đây cho thấy kết quả cho mô hình ResNet-50:

Hình 2. Hiệu suất suy luận máy chủ và ngoại tuyến của ResNet-50

Từ biểu đồ, chúng ta có thể rút ra các giá trị trên mỗi GPU. Chúng tôi chia thông lượng hệ thống (chứa tất cả các GPU) cho số lượng GPU để có kết quả Trên mỗi GPU khi chúng được chia tỷ lệ tuyến tính.

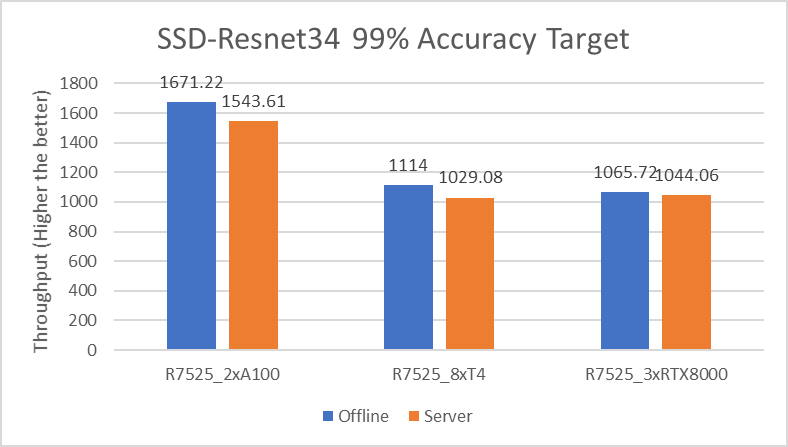

SSD-Resnet34

Hình dưới đây cho thấy kết quả đối với kiểu SSD-Resnet34:

Hình 3. Hiệu suất suy luận Máy chủ và Ngoại tuyến của SSD-Resnet34

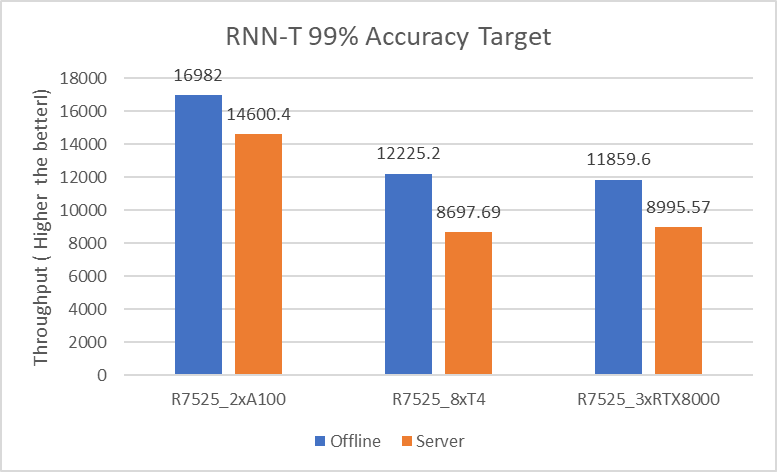

RNN-T

Hình dưới đây cho thấy kết quả của mô hình RNN-T:

Hình 4. Hiệu suất suy luận Máy chủ và Ngoại tuyến RNN-T

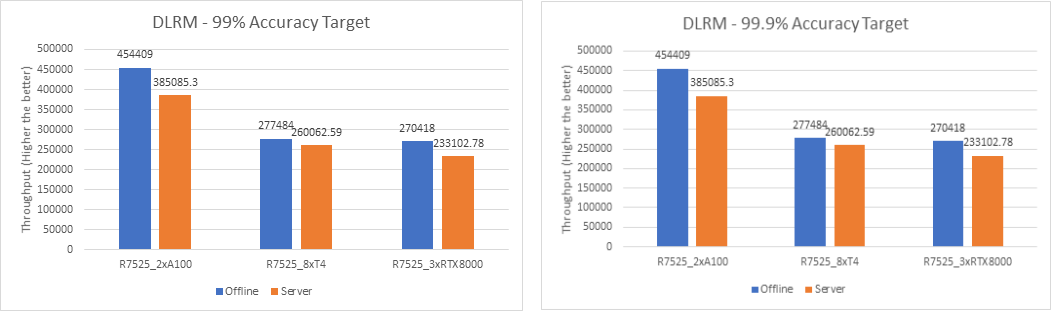

Điểm chuẩn mục tiêu chính xác 99,9%

DLRM

Các số liệu sau đây cho thấy kết quả của mô hình DLRM với độ chính xác 99% và 99,9%:

Hình 5. Hiệu suất suy luận DLRM Offline và Server Scenario – độ chính xác 99% và 99,9%

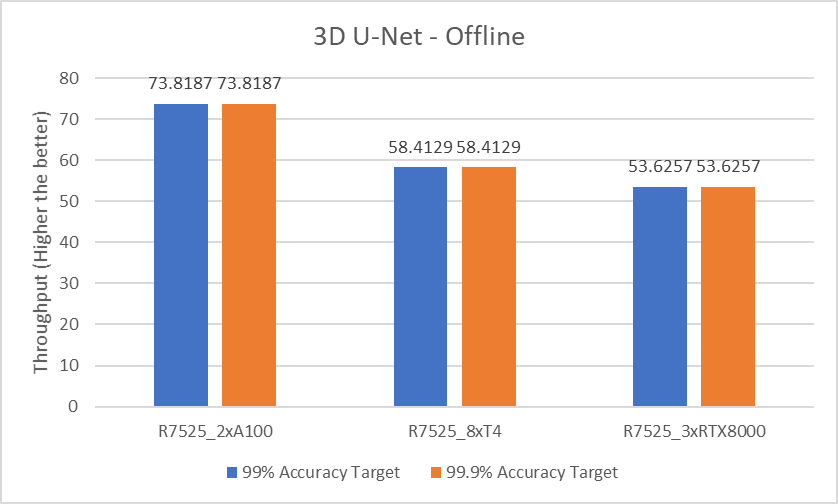

Đối với mô hình đề xuất DLRM và phân đoạn hình ảnh y tế 3D U-Net (xem Hình 7), cả độ chính xác 99% và 99,9% đều có cùng thông lượng. Điểm chuẩn chính xác 99,9% cũng đáp ứng các ràng buộc về độ chính xác cần thiết với thông lượng tương tự như 99%.

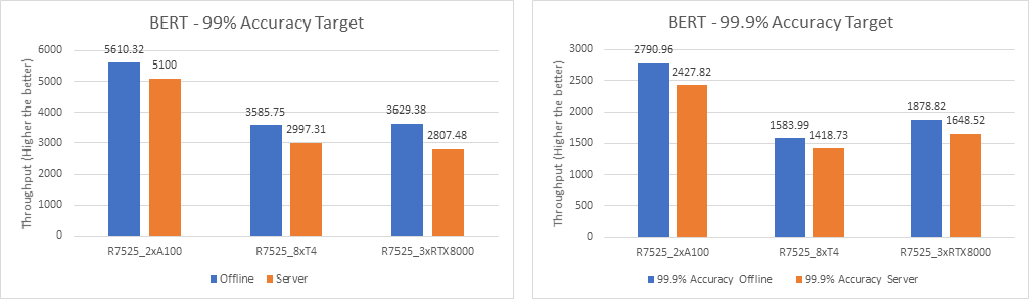

BERT

Các số liệu sau đây cho thấy kết quả của mô hình BERT với độ chính xác 99% và 99,9%:

Hình 6. Hiệu suất suy luận BERT Ngoại tuyến và Máy chủ – Độ chính xác 99% và 99,9%

Đối với mô hình xử lý ngôn ngữ BERT, hai GPU NVIDIA A100 hoạt động tốt hơn tám GPU NVIDIA T4 và ba GPU NVIDIA RTX8000. Tuy nhiên, hiệu suất của ba GPU NVIDIA RTX8000 tốt hơn một chút so với tám GPU NVIDIA T4.

U-Net 3D

Đối với mô hình phân vùng hình ảnh y tế 3D-Unet, chỉ có tiêu chuẩn kịch bản Ngoại tuyến khả dụng.

Hình dưới đây cho thấy kết quả cho kịch bản Ngoại tuyến mô hình 3D U-Net:

Hình 7. Hiệu suất suy luận 3D U-Net Offline

Đối với mô hình phân đoạn hình ảnh y tế 3D-Unet, vì chỉ có tiêu chuẩn kịch bản ngoại tuyến cho 3D-Unet nên biểu đồ trên chỉ biểu thị kịch bản Ngoại tuyến.

Bảng sau so sánh thông lượng giữa hai GPU NVIDIA A100, tám GPU NVIDIA T4 và ba GPU NVIDIA RTX8000 với điểm chuẩn mục tiêu chính xác 99% và mục tiêu chính xác 99,9%:

| Người mẫu | Kịch bản | Sự chính xác | 2 x GPU A100 so với 8 x GPU T4 | 2 x GPU A100 so với 3 x GPU RTX8000 |

| ResNet-50 | ngoại tuyến | 99% | 5,21x | 2,10 lần |

| Người phục vụ | 4,68 lần | 1,89 lần | ||

| SSD-Resnet34 | ngoại tuyến | 6,00 lần | 2,35 lần | |

| Người phục vụ | 5,99 lần | 2,21x | ||

| RNN-T | ngoại tuyến | 5,55 lần | 2,14 lần | |

| Người phục vụ | 6,71x | 2,43 lần | ||

| DLRM | ngoại tuyến | 6,55 lần | 2,52 lần | |

| Người phục vụ | 5,92 lần | 2,47 lần | ||

| ngoại tuyến | 99,9% | 6,55 lần | 2,52 lần | |

| Người phục vụ | 5,92 lần | 2,47 lần | ||

| BERT | ngoại tuyến | 99% | 6,26x | 2,31x |

| Người phục vụ | 6,80 lần | 2,72 lần | ||

| ngoại tuyến | 99,9% | 7,04x | 2,22 lần | |

| Người phục vụ | 6,84 lần | 2,20 lần | ||

| U-Net 3D | ngoại tuyến | 99% | 5,05x | 2,06 lần |

| Người phục vụ | 99,9% | 5,05x | 2,06 lần |

Sự kết luận

Với sự hỗ trợ của GPU NVIDIA A100, NVIDIA T4 hoặc NVIDIA RTX8000, máy chủ Dell EMC PowerEdge R7525 là một lựa chọn đặc biệt cho các khối lượng công việc khác nhau liên quan đến suy luận học sâu. Tuy nhiên, thông lượng cao hơn mà chúng tôi quan sát được với GPU NVIDIA A100 chuyển thành hiệu suất tăng và giá trị kinh doanh nhanh hơn cho các ứng dụng suy luận.

Máy chủ Dell EMC PowerEdge R7525 với hai GPU NVIDIA A100 mang lại hiệu suất tối ưu cho các khối lượng công việc suy luận khác nhau, cho dù đó là trong cài đặt suy luận hàng loạt như Kịch bản ngoại tuyến hay Cài đặt suy luận trực tuyến như Kịch bản máy chủ.

Bước tiếp theo

Trong các blog trong tương lai, chúng tôi sẽ thảo luận về việc định cỡ hệ thống (cấu hình máy chủ và GPU) một cách chính xác dựa trên loại khối lượng công việc (khu vực và nhiệm vụ).

Bài viết mới cập nhật

Dell Storage Engines: Tăng tốc suy luận AI với PowerScale và ObjectScale

Giải pháp chuyển tải bộ nhớ đệm KV của Dell cho ...

Bảo vệ Nhà máy AI

Áp dụng phương pháp tiếp cận kiến trúc để bảo mật ...

Tiến lên mạnh mẽ với Dell PowerMax: Vượt mặt Hitachi VSP 5000

Dell PowerMax mang lại khả năng phục hồi, hiệu suất và ...

Đẩy nhanh đổi mới AI: Sức mạnh của quyền truy cập mở

Từ các mô hình tiên tiến đến các ứng dụng cấp ...