Tin tức

Hướng dẫn thiết kế đã được xác thực của Dell để suy luận và tùy chỉnh mô hình – Cập nhật ngày 24 tháng 3

Đổi mới liên tục với các thiết kế đã được Dell xác nhận dành cho Generative AI với NVIDIA

Kể từ khi Dell Technologies và NVIDIA giới thiệu cái mà lúc đó được gọi là Project Helix cách đây chưa đầy một năm, rất nhiều thứ đã thay đổi. Tốc độ tăng trưởng và áp dụng AI có thể tạo ra đã nhanh hơn bất kỳ công nghệ nào trong lịch sử loài người.

Ngay từ đầu, Dell và NVIDIA đã đặt ra mục tiêu cung cấp một kiến trúc mô-đun và có thể mở rộng để hỗ trợ tất cả các khía cạnh của vòng đời AI tổng quát trong một môi trường tại chỗ, an toàn. Kiến trúc này được cố định bởi phần cứng máy chủ, bộ lưu trữ và mạng hiệu suất cao của Dell cũng như phần cứng mạng và tăng tốc NVIDIA cũng như phần mềm AI.

Kể từ lần giới thiệu đó, Thiết kế được xác thực của Dell cho Generative AI đã phát triển mạnh mẽ và được cập nhật liên tục để bổ sung thêm nhiều tùy chọn máy chủ, bộ lưu trữ và GPU nhằm phục vụ nhiều đối tượng khách hàng từ những người mới bắt đầu đến các hoạt động sản xuất cao cấp.

Kiến trúc mô-đun, có thể mở rộng được tối ưu hóa cho AI

Hành trình này được bắt đầu với việc phát hành Generative AI trong sách trắng Doanh nghiệp.

Hướng dẫn thiết kế này đã đặt nền tảng cho một loạt tài nguyên toàn diện nhằm tích hợp AI vào cài đặt doanh nghiệp tại chỗ, tập trung vào cơ sở hạ tầng sản xuất mô-đun và có thể mở rộng với sự cộng tác của NVIDIA.

Dell, được biết đến với chuyên môn không chỉ về cơ sở hạ tầng hiệu suất cao mà còn trong việc quản lý các thiết kế đã được xác thực toàn diện, đã hợp tác với NVIDIA để thiết kế các giải pháp AI tổng thể toàn diện kết hợp các công nghệ phần cứng và phần mềm tiên tiến. Bản chất năng động của AI đặt ra thách thức trong việc theo kịp những tiến bộ nhanh chóng, trong đó các mô hình tiên tiến ngày nay có thể nhanh chóng trở nên lỗi thời. Dell tạo sự khác biệt bằng cách cung cấp những hiểu biết sâu sắc và đề xuất cần thiết cho các ứng dụng cụ thể, giúp hành trình trở nên dễ dàng hơn trong bối cảnh AI đang phát triển nhanh chóng.

Nền tảng của kiến trúc chung là tính mô-đun, cung cấp một thiết kế linh hoạt phục vụ cho vô số trường hợp sử dụng, lĩnh vực và yêu cầu tính toán. Cơ sở hạ tầng AI thực sự theo mô-đun được thiết kế để có khả năng thích ứng và phù hợp với tương lai, với các thành phần có thể được kết hợp và kết hợp dựa trên các yêu cầu cụ thể của dự án và có thể trải dài từ đào tạo mô hình, đến tùy chỉnh mô hình, bao gồm nhiều phương pháp tinh chỉnh khác nhau, cho đến suy luận nơi chúng tôi đưa các mô hình vào hoạt động.

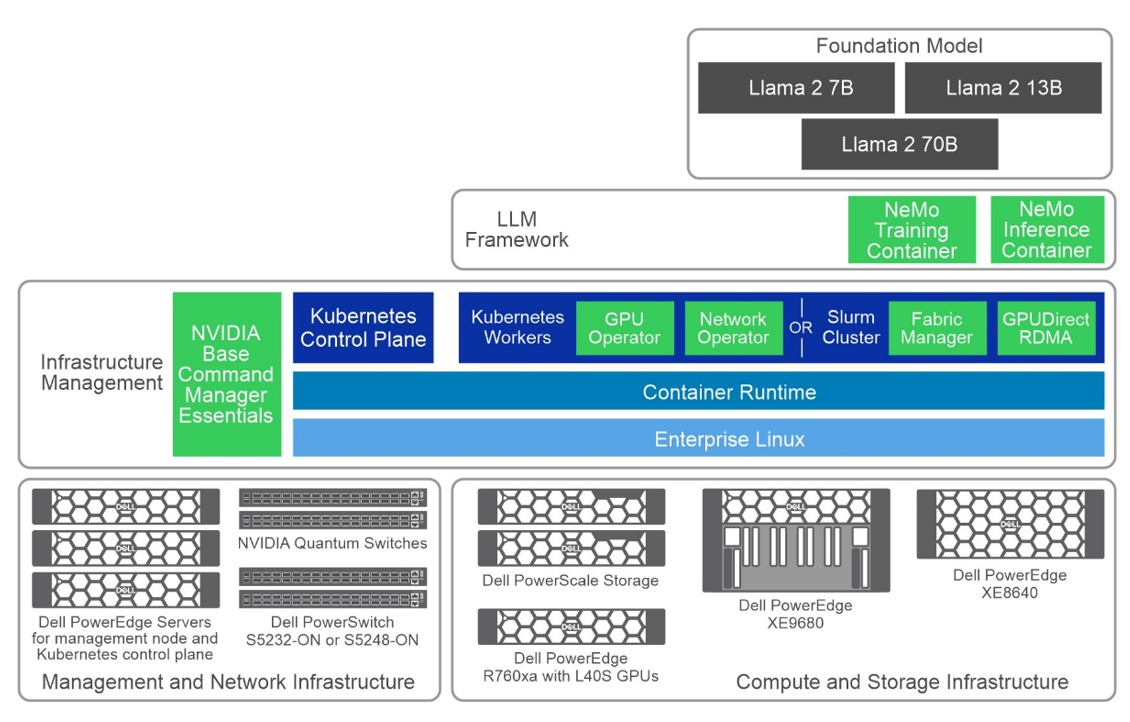

Hình dưới đây thể hiện cái nhìn cấp cao về kiến trúc tổng thể, bao gồm các thành phần phần cứng chính và ngăn xếp phần mềm:

Hình 1: Kiến trúc cấp cao phổ biến

Suy luận AI sáng tạo

Sau sách trắng giới thiệu, hướng dẫn thiết kế đã được xác thực đầu tiên được phát hành là dành cho Suy luận AI sáng tạo , vào tháng 7 năm 2023, dựa trên các khái niệm đổi mới được giới thiệu trước đó.

Sự phức tạp của việc lắp ráp cơ sở hạ tầng AI, thường liên quan đến sự kết hợp phức tạp giữa các thành phần nguồn mở và độc quyền, có thể rất lớn. Dell Technologies giải quyết sự phức tạp này bằng cách cung cấp các giải pháp được xác thực đầy đủ trong đó mọi yếu tố đều được kiểm tra tỉ mỉ, đảm bảo chức năng và tối ưu hóa cho việc triển khai. Việc xác thực này mang lại cho người dùng sự tự tin để tiếp tục khi biết rằng cơ sở hạ tầng AI của họ dựa trên cơ sở vững chắc và vững chắc.

Bài học chính

- Vào tháng 10 năm 2023, hướng dẫn này đã nhận được bản cập nhật đầu tiên, mở rộng phạm vi với các chi tiết cấu hình và xác thực bổ sung cho máy chủ Dell PowerEdge XE8640 và XE9680. Bản cập nhật này cũng giới thiệu hỗ trợ cho NVIDIA Base Command Manager Essentials và NVIDIA AI Enterprise 4.0, đánh dấu sự cải tiến đáng kể về chiều rộng và chiều sâu của hướng dẫn.

- Quá trình phát triển của hướng dẫn này tiếp tục kéo dài đến tháng 3 năm 2024 với phiên bản thứ ba, bao gồm hỗ trợ cho các máy chủ PowerEdge R760xa được trang bị GPU NVIDIA L40S.

- Thiết kế hiện hỗ trợ một số tùy chọn cho các thành phần tăng tốc GPU NVIDIA trên nhiều tùy chọn máy chủ Dell. Trong thiết kế này, chúng tôi giới thiệu ba máy chủ Dell PowerEdge với một số tùy chọn GPU được thiết kế riêng cho mục đích sáng tạo AI:

- Máy chủ PowerEdge R760xa, hỗ trợ tối đa bốn GPU NVIDIA H100 hoặc bốn GPU NVIDIA L40S

- Máy chủ PowerEdge XE8640, hỗ trợ tới 4 GPU NVIDIA H100

- Máy chủ PowerEdge XE9680, hỗ trợ tới 8 GPU NVIDIA H100

Việc lựa chọn kết hợp máy chủ và GPU thường là sự cân bằng giữa hiệu suất, chi phí và tính khả dụng, tùy thuộc vào quy mô và độ phức tạp của khối lượng công việc.

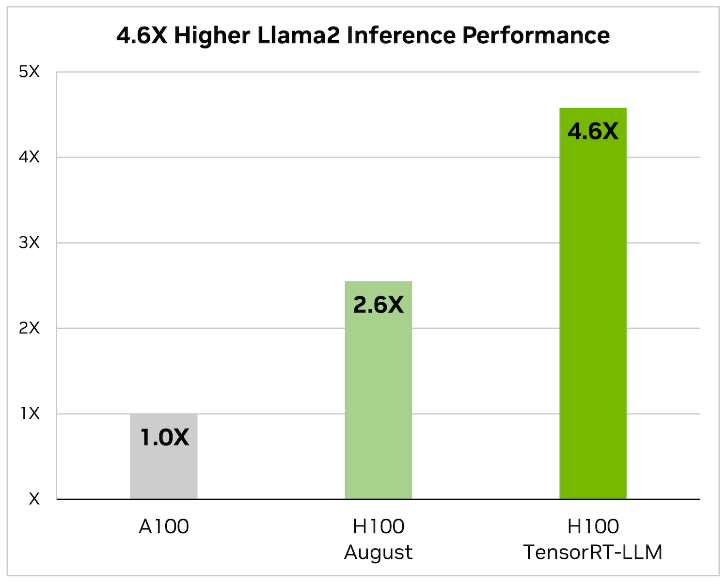

- Phiên bản mới nhất này cũng chứng kiến việc loại bỏ NVIDIA FasterTransformer, thay thế bằng TensorRT-LLM, phản ánh cam kết của Dell trong việc luôn cập nhật hướng dẫn về các công nghệ mới nhất và hiệu quả nhất. Khi nói đến việc tối ưu hóa các mô hình ngôn ngữ lớn, TensorRT-LLM chính là chìa khóa. Nó đảm bảo rằng các mô hình không chỉ mang lại hiệu suất cao mà còn duy trì hiệu quả trong các ứng dụng khác nhau.

Thư viện bao gồm các hạt nhân được tối ưu hóa, các bước xử lý trước và sau cũng như các nguyên tắc giao tiếp đa GPU/đa nút. Những tính năng này được thiết kế đặc biệt để nâng cao hiệu suất trên GPU NVIDIA.

Nó sử dụng cơ chế song song tensor để suy luận hiệu quả trên nhiều GPU và máy chủ mà không cần sự can thiệp của nhà phát triển hoặc thay đổi mô hình.

- Ngoài ra, bản cập nhật này bao gồm các bản sửa đổi đối với các mô hình được sử dụng để xác thực, đảm bảo người dùng có quyền truy cập vào thông tin mới nhất và phù hợp nhất cho việc triển khai AI của họ. Hướng dẫn Thiết kế được xác thực của Dell bao gồm Llama 2 và bây giờ là Mistral làm mô hình nền tảng để suy luận với thiết kế cơ sở hạ tầng này với Máy chủ suy luận Triton:

- Llama 2 7B, 13B và 70B

- Mistral

- Chim ưng 180B

- Cuối cùng (và quan trọng nhất) kết quả kiểm tra hiệu suất và cân nhắc về kích thước cho thấy tính hiệu quả của kiến trúc cập nhật này trong việc xử lý các mô hình ngôn ngữ lớn (LLM) cho các tác vụ suy luận khác nhau. Những điểm chính bao gồm:

- Độ trễ và thông lượng được tối ưu hóa —Thiết kế đã đạt được các số liệu về độ trễ ấn tượng, rất quan trọng đối với các ứng dụng thời gian thực như chatbot và mã thông báo cao mỗi giây, cho thấy khả năng xử lý hiệu quả đối với các tác vụ ngoại tuyến.

- Tác động của tính song song của mô hình —Hiệu suất của LLM thay đổi theo các điều chỉnh về độ song song của tenxơ và đường dẫn, nêu bật tầm quan trọng của cài đặt song song tối ưu để tối đa hóa hiệu quả suy luận.

- Khả năng mở rộng với các cấu hình GPU khác nhau —Các thử nghiệm trên nhiều GPU NVIDIA khác nhau, bao gồm các mẫu L40S và H100, đã chứng minh khả năng mở rộng của thiết kế và khả năng đáp ứng các nhu cầu tính toán đa dạng của nó.

- Hỗ trợ mô hình toàn diện — Hướng dẫn bao gồm dữ liệu hiệu suất cho nhiều mô hình (như chúng ta đã thảo luận) trên các cấu hình khác nhau, thể hiện tính linh hoạt của thiết kế trong việc xử lý các LLM khác nhau.

- Nguyên tắc định cỡ —Dựa trên số liệu hiệu suất, các ví dụ định cỡ được cập nhật có sẵn để giúp người dùng xác định cơ sở hạ tầng phù hợp dựa trên yêu cầu suy luận cụ thể của họ (rất hoan nghênh những hướng dẫn này)

Tất cả điều này nêu bật các cam kết và khả năng của Dell trong việc cung cấp các giải pháp suy luận AI tổng hợp hiệu suất cao, có thể mở rộng và hiệu quả phù hợp với nhu cầu của doanh nghiệp.

Tùy chỉnh mô hình AI sáng tạo

Hướng dẫn thiết kế đã được xác thực cho Tùy chỉnh mô hình AI sáng tạo được phát hành lần đầu tiên vào tháng 10 năm 2023, dựa trên máy chủ PowerEdge XE9680. Hướng dẫn này nêu chi tiết nhiều phương pháp tùy chỉnh mô hình, bao gồm các chi tiết cụ thể về kỹ thuật kịp thời, tinh chỉnh có giám sát và tinh chỉnh hiệu quả về tham số.

Các bản cập nhật cho Hướng dẫn thiết kế được xác thực của Dell từ tháng 10 năm 2023 đến tháng 3 năm 2024 bao gồm bản phát hành ban đầu, bổ sung các kịch bản đã được xác thực cho SFT nhiều nút và Kubernetes vào tháng 11 năm 2023, cập nhật kết quả kiểm tra hiệu suất và hỗ trợ mới cho máy chủ PowerEdge R760xa, PowerEdge XE8640 máy chủ và bộ lưu trữ toàn flash PowerScale F710 kể từ tháng 3 năm 2024.

Bài học chính

- Việc xác thực nhằm kiểm tra độ tin cậy, hiệu suất, khả năng mở rộng và khả năng tương tác của hệ thống bằng cách sử dụng tùy chỉnh mô hình trong khung NeMo, đặc biệt tập trung vào việc kết hợp kiến thức cụ thể của miền vào Mô hình ngôn ngữ lớn (LLM).

- Quá trình này bao gồm việc thử nghiệm các mô hình cơ bản có kích thước 7B, 13B và 70B từ dòng Llama 2. Nhiều kỹ thuật tùy chỉnh mô hình khác nhau đã được sử dụng, bao gồm:

- Kỹ thuật nhanh chóng

- Tinh chỉnh có giám sát (SFT)

- Điều chỉnh P và

- Thích ứng cấp thấp của các mô hình ngôn ngữ lớn (LoRA)

- Thiết kế hiện hỗ trợ một số tùy chọn cho các thành phần tăng tốc GPU NVIDIA trên nhiều tùy chọn máy chủ Dell. Trong thiết kế này, chúng tôi giới thiệu ba máy chủ Dell PowerEdge với một số tùy chọn GPU được thiết kế riêng cho mục đích sáng tạo AI:

- Máy chủ PowerEdge R760xa, hỗ trợ tối đa 4 GPU NVIDIA H100 hoặc 4 GPU NVIDIA L40S. Trong khi L40S tiết kiệm chi phí cho khối lượng công việc vừa và nhỏ thì H100 thường được sử dụng cho các tác vụ quy mô lớn hơn, bao gồm cả SFT.

- Máy chủ PowerEdge XE8640, hỗ trợ tối đa 4 GPU NVIDIA H100.

- Máy chủ PowerEdge XE9680, hỗ trợ tới 8 GPU NVIDIA H100.

Như mọi khi, việc lựa chọn kết hợp máy chủ và GPU phụ thuộc vào quy mô và độ phức tạp của khối lượng công việc.

- Quá trình xác thực đã sử dụng cả cụm Slurm và Kubernetes cho tài nguyên tính toán và liên quan đến hai tập dữ liệu: tập dữ liệu Dolly từ Databricks, bao gồm các danh mục hành vi khác nhau và tập dữ liệu Alpaca từ OpenAI, bao gồm 52.000 bản ghi theo hướng dẫn. Quá trình đào tạo được thực hiện tối thiểu 50 bước, với mục tiêu là xác thực khả năng của hệ thống thay vì đạt được sự hội tụ của mô hình, nhằm cung cấp những hiểu biết sâu sắc phù hợp với nhu cầu của khách hàng tiềm năng.

Bạn có thể tìm thấy kết quả xác thực cùng với phân tích của chúng tôi trong phần Đặc tính hiệu suất của hướng dẫn thiết kế.

Bài viết mới cập nhật

Tăng tốc khối lượng công việc của Hệ thống tệp mạng (NFS) của bạn với RDMA

Giao thức NFS hiện nay được sử dụng rộng rãi trong ...

Mẹo nhanh về dữ liệu phi cấu trúc – OneFS Protection Overhead

Gần đây đã có một số câu hỏi từ lĩnh vực ...

Giới thiệu Dell PowerScale OneFS dành cho Quản trị viên NetApp

Để các doanh nghiệp khai thác được lợi thế của công ...

Cơ sở hạ tầng CNTT: Mua hay đăng ký?

Nghiên cứu theo số liệu của IDC về giải pháp đăng ...