Tin tức

So sánh các Bộ tăng tốc hàng đầu từ Bài đăng MLPerf™ Inference v3.0 của Dell Technologies

Dell Technologies gần đây đã gửi kết quả tới MLPerf TM Inference v3.0 ở bộ phận kín. Blog này nêu bật GPU NVIDIA H100 PCIe và so sánh kết quả với GPU NVIDIA A100 PCIe với hệ số dạng PCIe được giữ không đổi.

Giới thiệu

Việc gửi MLPerf Inference v3.0 nằm trong trụ cột đo điểm chuẩn của tập đoàn MLCommons TM với mục tiêu đưa ra những so sánh công bằng giữa các cấu hình máy chủ. Các đệ trình được gửi tới bộ phận khép kín đảm bảo sự so sánh công bằng của các hệ thống.

Blog này nêu bật các đề xuất phân chia khép kín mà Dell Technologies thực hiện với GPU NVIDIA A100 bằng cách sử dụng hệ số dạng PCIe (kết nối thành phần ngoại vi). Hệ số dạng PCIe là một tiêu chuẩn giao tiếp để kết nối nhiều thành phần tốc độ cao khác nhau trong phần cứng như máy tính hoặc máy chủ. Máy chủ bao gồm một số khe cắm PCIe nhất định để lắp GPU hoặc các thẻ bổ sung khác. Lưu ý rằng có các cấu hình vật lý khác nhau cho các khe cắm để biểu thị số làn cho dữ liệu di chuyển đến và đi từ thẻ PCIe. GPU NVIDIA H100 thực sự là GPU mới nhất và tuyệt vời nhất được tích hợp NVIDIA AI Enterprise ; nó là GPU PCIe thế hệ 5.0 làm mát bằng không khí hai khe cắm. GPU này chạy ở tốc độ băng thông bộ nhớ trên 2.000 megabit/giây và tối đa bảy GPU đa phiên bản với tốc độ 10 gigabyte mỗi GPU. GPU NVIDIA A100 80 GB là GPU PCIe thế hệ 4.0 hai khe chạy ở tốc độ băng thông bộ nhớ trên 2.000 megabit/giây.

So sánh GPU NVIDIA H100 PCIe và GPU NVIDIA A100 PCIe

Ngoài việc gửi bài bằng GPU NVIDIA A100, Dell Technologies còn gửi bài bằng GPU NVIDIA H100. Để so sánh công bằng, các hệ thống giống hệt nhau và hệ số dạng PCIe được giữ không đổi.

| Nền tảng | Dell PowerEdge R750xa (4x A100-PCIe-80GB, TensorRT) | Dell PowerEdge R750xa (4x H100-PCIe-80GB, TensorRT) |

| Tròn | V3.0 | |

| ID hệ thống MLPerf | R750xa_A100_PCIe_80GBx4_TRT | R750xa_H100_PCIe_80GBx4_TRT |

| Hệ điều hành | CentOS 8.2 | |

| CPU | CPU Intel Xeon Gold 6338 @ 2,00 GHz | |

| Ký ức | 1 TB | 1 TB |

| GPU | NVIDIA A100-PCIe-80GB | NVIDIA H100-PCIe-80GB |

| Yếu tố hình thức GPU | PCIe | |

| Cấu hình bộ nhớ GPU | HBM2e | |

| số lượng GPU | 4 | |

| ngăn xếp phần mềm | TenorRT 8.6

CUDA 12.0 cuDNN 8.8.0 Trình điều khiển 525.85.12 ĐẠI LÝ 1.17.0 |

TenorRT 8.6

CUDA 12.0 cuDNN 8.8.0 Trình điều khiển 525.60.13 ĐẠI LÝ 1.17.0 |

Bảng 1: Phần mềm gửi đi được thực hiện trên GPU NVIDIA A100 PCIe và NVIDIA H100 PCIe cho MLPerf Inference v3.0 trên máy chủ Dell PowerEdge R750xa

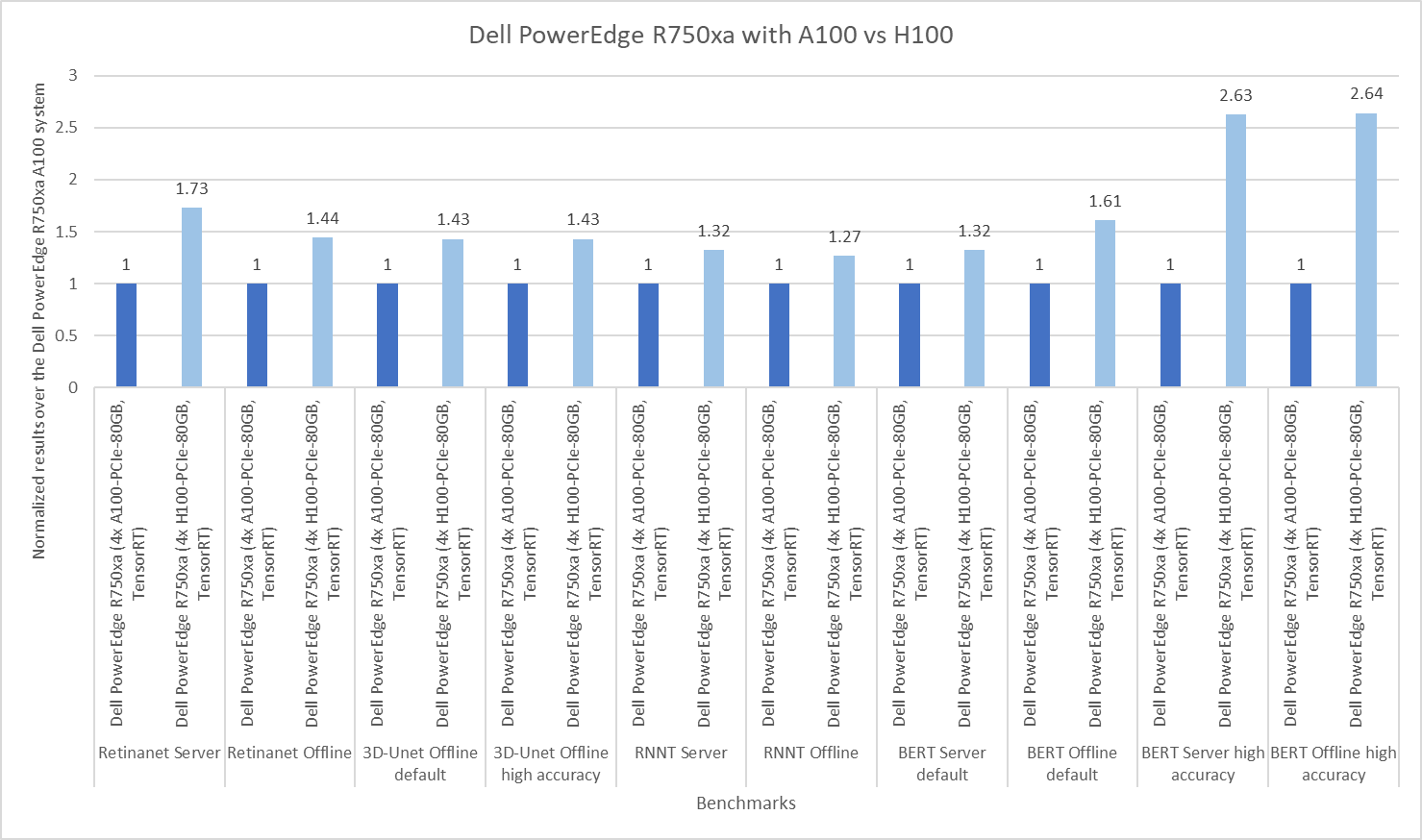

Trong hình dưới đây, số lượng trên mỗi thẻ được chuẩn hóa theo kết quả GPU NVIDIA A100 để hiển thị so sánh dễ đọc giữa các GPU trên cùng một hệ thống. Trong khả năng phát hiện đối tượng, phân đoạn hình ảnh y tế cũng như xử lý giọng nói thành văn bản và ngôn ngữ tự nhiên, GPU NVIDIA H100 mới nhất vượt trội so với phiên bản tiền nhiệm ở tất cả các hạng mục. Ghi nhận hiệu năng vượt trội của máy chủ Dell PowerEdge R750xa với GPU NVIDIA H100 với chuẩn BERT ở chế độ chính xác cao. Với những tiến bộ trong trí tuệ nhân tạo tổng hợp, máy chủ Dell PowerEdge R750xa là một nền tảng linh hoạt, đáng tin cậy và hiệu suất cao.

Hình 1: Chuẩn hóa theo so sánh GPU của GPU NVIDIA A100 và NVIDIA H100 trên máy chủ Dell PowerEdge R750xa

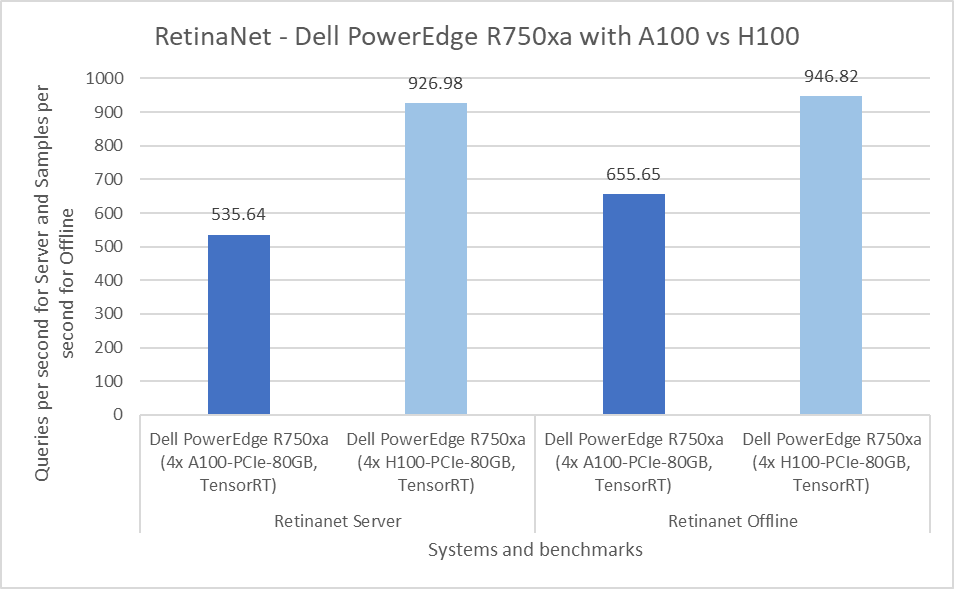

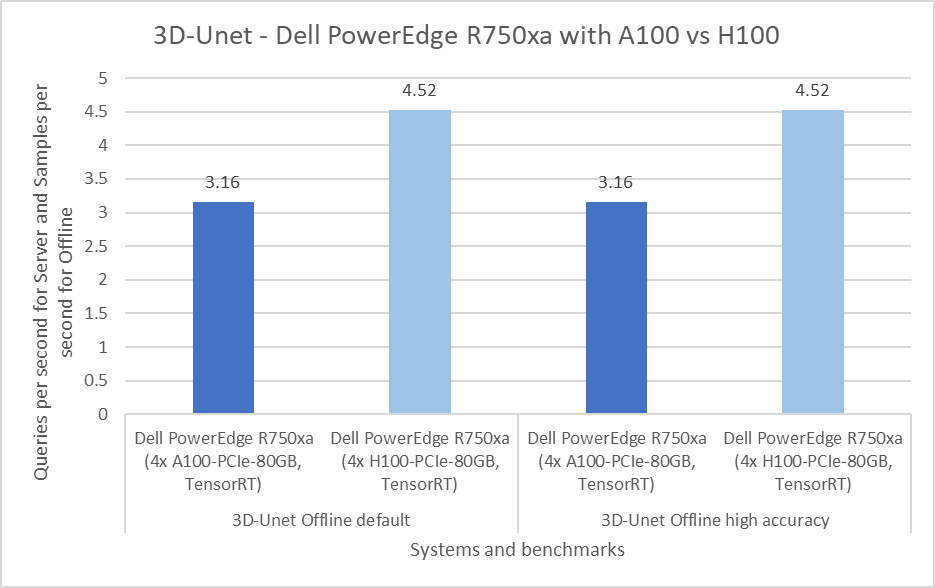

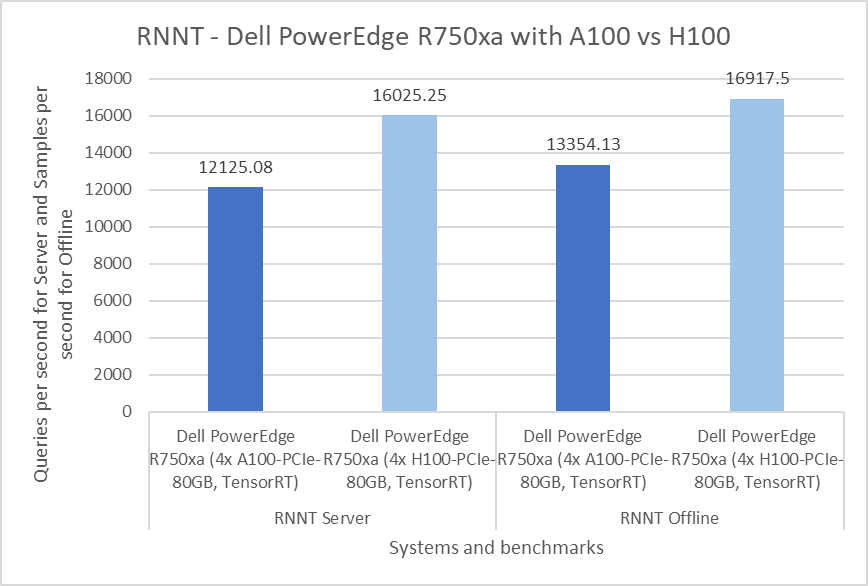

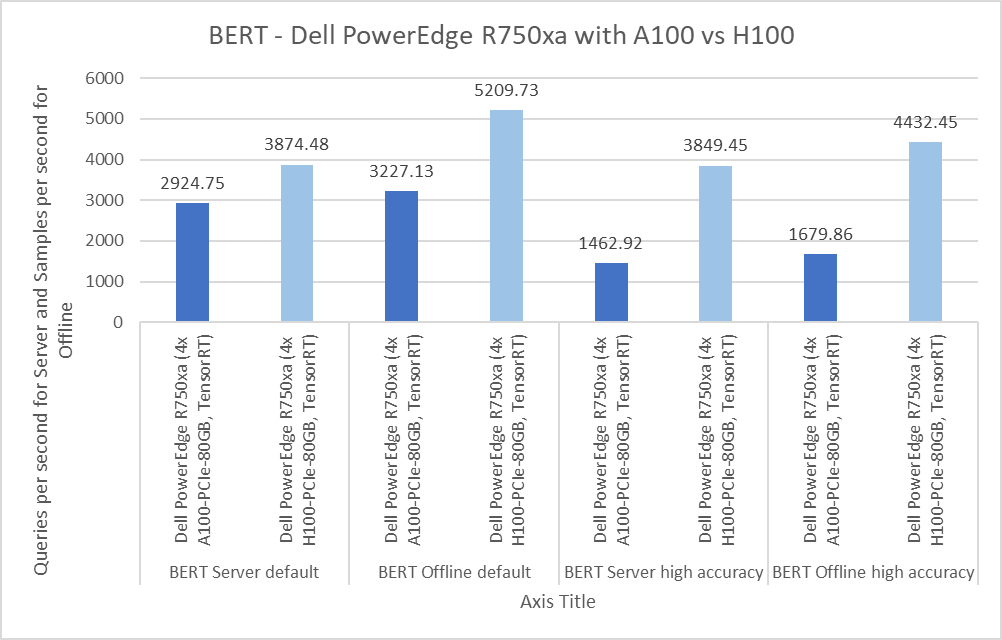

Các số liệu sau đây hiển thị những con số tuyệt đối để so sánh GPU NVIDIA H100 và NVIDIA A100.

Hình 2: So sánh mỗi GPU của GPU NVIDIA A100 và NVIDIA H100 cho RetinaNet trên máy chủ PowerEdge R750xa

Hình 3: So sánh mỗi GPU của GPU NVIDIA A100 và NVIDIA H100 cho 3D-Unet trên máy chủ PowerEdge R750xa

Hình 4: So sánh mỗi GPU của GPU NVIDIA A100 và NVIDIA H100 cho RNNT trên máy chủ PowerEdge R750xa

Hình 5: So sánh mỗi GPU của GPU NVIDIA A100 và NVIDIA H100 cho BERT trên máy chủ PowerEdge R750xa

Những kết quả này có thể được tìm thấy trên trang web MLCommons .

Các bài gửi được thực hiện bằng GPU NVIDIA A100 PCIe

Trong vòng gửi bài này, Dell Technologies đã gửi kết quả trên máy chủ PowerEdge R750xa được trang bị bốn GPU PCIe NVIDIA A100 80 GB. Trong các vòng trước, máy chủ PowerEdge R750xa đã thể hiện hiệu năng vượt trội trên tất cả các điểm chuẩn. Để tìm hiểu sâu hơn về bài nộp của vòng trước, hãy xem blog của chúng tôi từ MLPerf Inference v2.0 . Từ vòng gửi MLPerf Inference v2.1 trước đó, Dell Technologies đã gửi kết quả trên một hệ thống giống hệt nhau. Tuy nhiên, qua hai vòng gửi, điểm khác biệt chính là các bản nâng cấp trong ngăn xếp phần mềm, như được mô tả trong bảng sau:

| Nền tảng | Dell PowerEdge R750xa (4x A100-PCIe-80GB, TensorRT) | Dell PowerEdge R750xa (4x A100-PCIe-80GB, TensorRT) |

| Tròn | V3.0 | V2.1 |

| ID hệ thống MLPerf | R750xa_A100_PCIe_80GBx4_TRT | |

| Hệ điều hành | CentOS 8.2 | |

| CPU | CPU Intel Xeon Gold 6338 @ 2,00 GHz | |

| Ký ức | 512 GB | |

| GPU | NVIDIA A100-PCIe-80GB | |

| Yếu tố hình thức GPU | PCIe | |

| Cấu hình bộ nhớ GPU | HBM2e | |

| số lượng GPU | 4 | |

| ngăn xếp phần mềm | TenorRT 8.6

CUDA 12.0 cuDNN 8.8.0 Trình điều khiển 525.85.12 ĐẠI LÝ 1.17.0 |

TenorRT 8.4.2

CUDA 11.6 cuDNN 8.4.1 Tài xế 510.39.01 ĐẠI LÝ 0.31.0 |

Bảng 2: Ngăn xếp phần mềm dành cho các bài gửi được thực hiện trên GPU NVIDIA A100 PCIe trong MLPerf Inference v3.0 và v2.1

So sánh kết quả PowerEdge R750xa NVIDIA A100 từ Inference v3.0 và v2.1

Phát hiện đối tượng

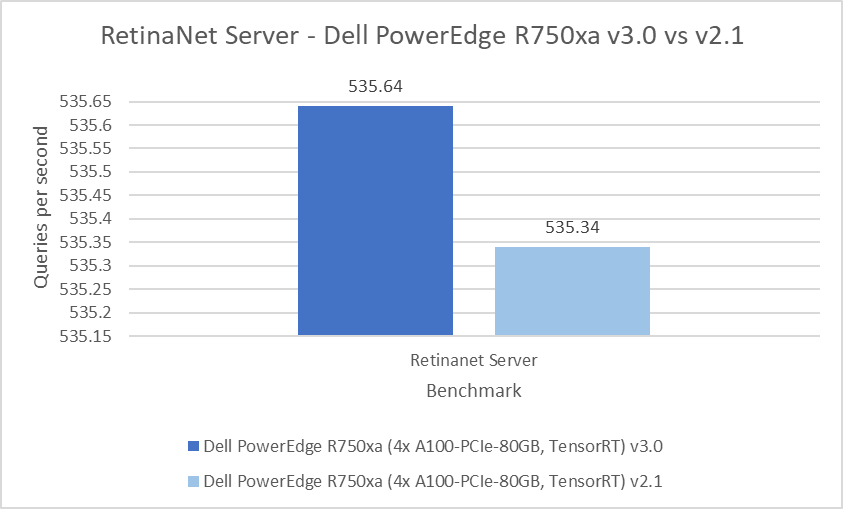

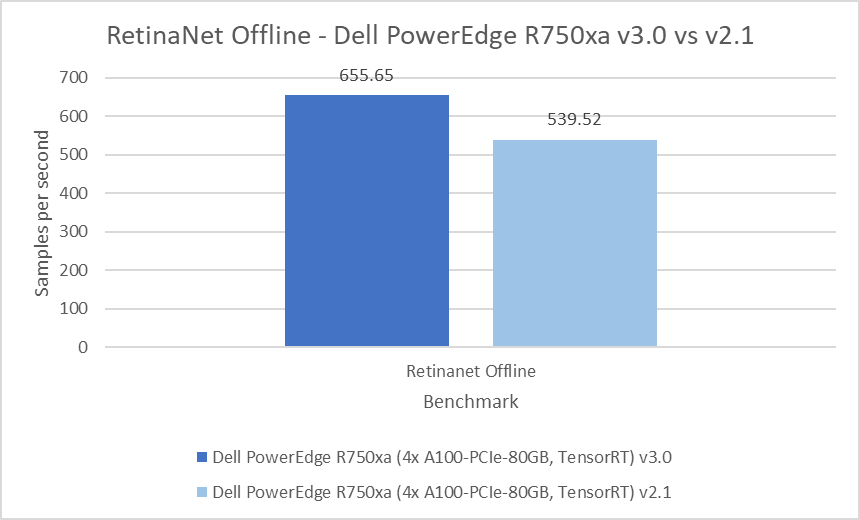

Điểm chuẩn RetinaNet thuộc danh mục phát hiện đối tượng và sử dụng bộ dữ liệu OpenImages. Kết quả từ Inference v3.0 cho thấy chênh lệch ít hơn 0,05 phần trăm trong kịch bản Máy chủ và chênh lệch 21,53 phần trăm trong kịch bản Ngoại tuyến. Lý do tiềm ẩn cho kết quả này có thể là do sự tối ưu hóa của NVIDIA, như đã nêu trong blog kỹ thuật của họ .

Hình 6: Kết quả RetinaNet Server và offline trên máy chủ PowerEdge R750xa từ Inference v3.0 và Inference v2.1

Phân đoạn hình ảnh y tế

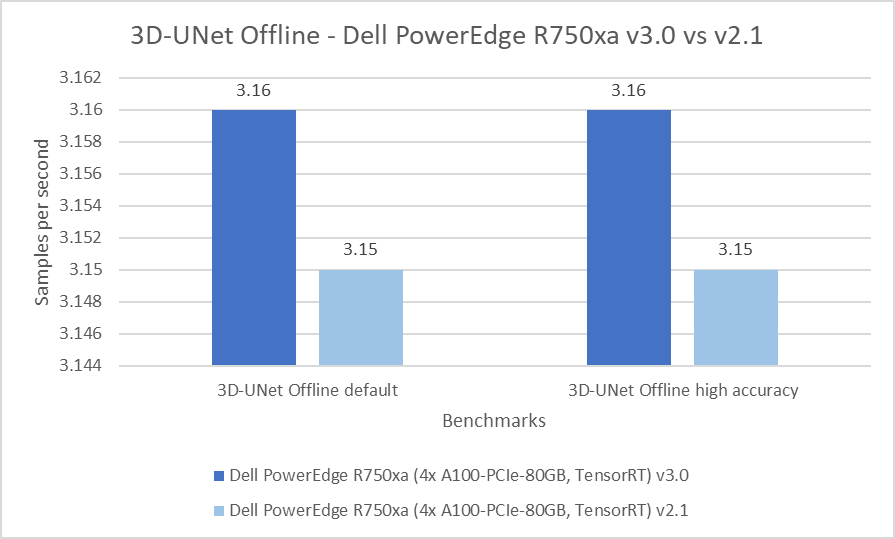

Điểm chuẩn 3D-Unet thực hiện nhiệm vụ phân đoạn khối u thận KiTS 2019 . Qua hai vòng gửi, máy chủ PowerEdge R750xa hoạt động ổn định với mức chênh lệch 0,3% ở cả chế độ mặc định và chế độ có độ chính xác cao.

Hình 7: Kết quả 3D-UNet offline trên máy chủ PowerEdge R750xa từ Inference v3.0 và v2.1

Lời nói thành văn bản

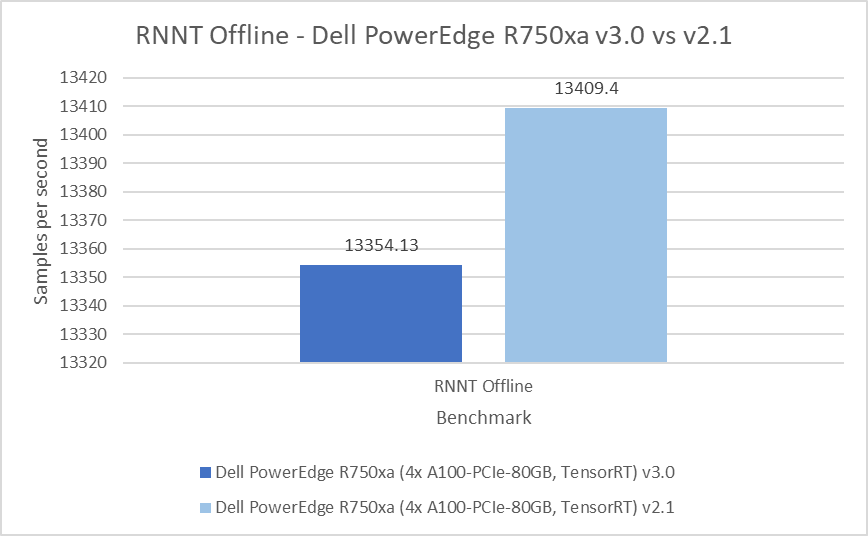

Mô hình Bộ chuyển đổi mạng thần kinh tái phát (RNNT) thuộc danh mục nhận dạng giọng nói. Điểm chuẩn này chấp nhận các mẫu âm thanh thô và tạo ra bản phiên âm ký tự tương ứng. Trong kịch bản Máy chủ, kết quả nằm trong mức chênh lệch 2,25 phần trăm và chênh lệch 0,41 phần trăm trong kịch bản Ngoại tuyến.

Hình 8: Kết quả RNNT Server và offline trên máy chủ Dell PowerEdge R750xa từ Inference v3.0 và v2.1

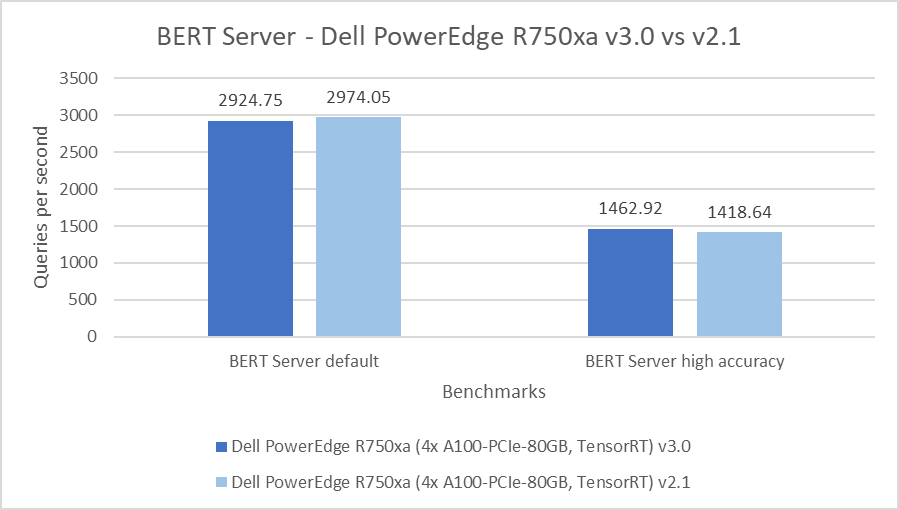

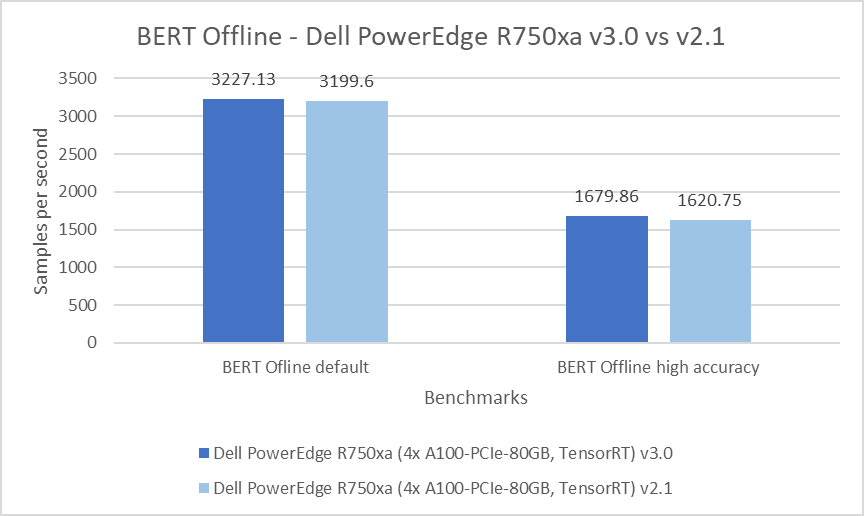

Xử lý ngôn ngữ tự nhiên

Biểu diễn bộ mã hóa hai chiều từ Transformers (BERT) là mô hình biểu diễn ngôn ngữ tiên tiến dành cho các ứng dụng Xử lý ngôn ngữ tự nhiên. Điểm chuẩn này thực hiện nhiệm vụ trả lời câu hỏi SQuAD. Điểm chuẩn BERT bao gồm các chế độ mặc định và có độ chính xác cao cho các tình huống Ngoại tuyến và Máy chủ. Đối với các kịch bản Máy chủ, kết quả của chế độ mặc định nằm trong phạm vi 1,69 phần trăm và phạm vi 3,12 phần trăm đối với chế độ có độ chính xác cao. Đối với các tình huống Ngoại tuyến, có thể nhận thấy hành vi tương tự trong đó kết quả của chế độ mặc định nằm trong phạm vi 0,86 phần trăm và phạm vi 3,65 phần trăm ở chế độ có độ chính xác cao.

Hình 9: Kết quả BERT Server và offline trên máy chủ PowerEdge R750xa từ Inference v3.0 và v2.1

Phần kết luận

Qua nhiều vòng gửi tới bộ điểm chuẩn MLPerf Inference, máy chủ PowerEdge R750xa luôn đạt hiệu suất cao nhất cho mọi tác vụ học máy, từ phát hiện đối tượng, phân đoạn hình ảnh y tế, lời nói đến văn bản và xử lý ngôn ngữ tự nhiên. Máy chủ PowerEdge R750xa tiếp tục là sự lựa chọn máy chủ tuyệt vời cho khối lượng công việc suy luận máy học. Khách hàng có thể tận dụng các kết quả đa dạng được gửi trên máy chủ Dell PowerEdge R750xa với GPU NVIDIA H100 để đưa ra quyết định sáng suốt cho nhu cầu giải pháp cụ thể của mình.

Bài viết mới cập nhật

Công bố các bản nâng cấp không gây gián đoạn dựa trên Drain (NDU)

Trong quy trình làm việc NDU, các nút được khởi động ...

Tăng tốc khối lượng công việc của Hệ thống tệp mạng (NFS) của bạn với RDMA

Giao thức NFS hiện nay được sử dụng rộng rãi trong ...

Mẹo nhanh về dữ liệu phi cấu trúc – OneFS Protection Overhead

Gần đây đã có một số câu hỏi từ lĩnh vực ...

Giới thiệu Dell PowerScale OneFS dành cho Quản trị viên NetApp

Để các doanh nghiệp khai thác được lợi thế của công ...